为随机图片API添加AI鉴黄功能:保护你的网站安全

你好,我是sakuraseven。在之前的两篇教程中,我们构建了随机图片API和React图片展示墙。今天,我们将解决一个关键问题:如何防止不适宜内容(NSFW)出现在你的应用中?

为什么需要内容安全检测?

在开发图片服务时,内容安全是不可忽视的挑战:

用户上传的图片可能包含不当内容

爬取的网络图片质量不可控

不良内容可能导致法律风险

影响网站品牌形象和用户体验

传统解决方案的不足:

人工审核:成本高、效率低

黑名单过滤:覆盖面有限

第三方API:费用昂贵(如Google Cloud Vision $1.5/1000张)

我们的技术方案:TensorFlow.js + NSFWJS

我将教你使用纯前端技术实现实时图片检测:

✅ 100%客户端处理(隐私保护)

✅ 免费开源方案

✅ 实时检测(<500ms)

✅ 可离线使用

系统架构

用户请求 → 随机图片API → 返回图片URL → React组件 → TensorFlow.js检测 → 安全显示/替换实现步骤

1. 准备工作

安装所需库:

npm install @tensorflow/tfjs @tensorflow-models/nsfwjs2. 创建安全图片组件 (SafeImage.js)

import React, { useState, useRef, useEffect } from 'react';

import * as tf from '@tensorflow/tfjs';

import * as nsfwjs from 'nsfwjs';

const SafeImage = ({ src, alt, fallbackSrc }) => {

const [isSafe, setIsSafe] = useState(null);

const [isLoading, setIsLoading] = useState(true);

const imgRef = useRef();

const modelRef = useRef();

// 加载NSFW模型

useEffect(() => {

const loadModel = async () => {

try {

modelRef.current = await nsfwjs.load();

console.log('安全检测模型加载完成');

} catch (error) {

console.error('模型加载失败:', error);

}

};

loadModel();

return () => {

if (modelRef.current) {

modelRef.current.dispose();

}

};

}, []);

// 图片加载后执行检测

useEffect(() => {

const detect = async () => {

if (!modelRef.current || !imgRef.current) return;

try {

setIsLoading(true);

// 使用TensorFlow.js进行检测

const predictions = await modelRef.current.classify(imgRef.current);

// 分析结果 - 重点关注Porn和Hentai类别

const pornScore = predictions.find(p => p.className === 'Porn')?.probability || 0;

const hentaiScore = predictions.find(p => p.className === 'Hentai')?.probability || 0;

// 设置安全阈值 (可调整)

const isImageSafe = pornScore < 0.5 && hentaiScore < 0.6;

setIsSafe(isImageSafe);

} catch (error) {

console.error('安全检测失败:', error);

setIsSafe(true); // 出错时默认显示

} finally {

setIsLoading(false);

}

};

if (imgRef.current?.complete) {

detect();

} else {

imgRef.current.onload = detect;

}

}, [src]);

return (

<div className="safe-image-container">

{isLoading && (

<div className="safety-check">

<div className="scanner"></div>

<span>安全检查中...</span>

</div>

)}

{isSafe === false ? (

<div className="unsafe-content">

<img src={fallbackSrc} alt="安全替代图片" />

<div className="warning-overlay">

<div className="warning-icon">⚠️</div>

<p>此图片已被屏蔽</p>

</div>

</div>

) : (

<img

ref={imgRef}

src={src}

alt={alt}

style={{ display: isLoading ? 'none' : 'block' }}

/>

)}

</div>

);

};

export default SafeImage;3. 在图片墙中集成安全组件

// 修改ImageCard.js

import SafeImage from './SafeImage';

const ImageCard = ({ imgUrl }) => {

return (

<div className="image-card">

<SafeImage

src={imgUrl}

alt="随机图片"

fallbackSrc="/safe-placeholder.jpg" // 准备一张安全替代图片

/>

</div>

);

};关键优化技巧

1. 模型加载优化(减少80%加载时间)

// 创建全局模型加载器

let nsfwModelPromise = null;

const getModel = async () => {

if (!nsfwModelPromise) {

nsfwModelPromise = nsfwjs.load();

}

return nsfwModelPromise;

};

// 在组件中使用

useEffect(() => {

const init = async () => {

modelRef.current = await getModel();

};

init();

}, []);2. 性能优化(避免阻塞UI)

// 使用Web Worker进行后台检测

const createDetectionWorker = () => {

const workerCode = `

importScripts('https://cdn.jsdelivr.net/npm/@tensorflow/tfjs');

importScripts('https://cdn.jsdelivr.net/npm/@tensorflow-models/nsfwjs');

let model;

self.onmessage = async (e) => {

if (e.data.type === 'init') {

model = await nsfwjs.load();

self.postMessage({ type: 'ready' });

} else if (e.data.type === 'detect' && model) {

const img = e.data.img;

const predictions = await model.classify(img);

self.postMessage({

type: 'result',

predictions

});

}

};

`;

const blob = new Blob([workerCode], { type: 'application/javascript' });

return new Worker(URL.createObjectURL(blob));

};3. 安全阈值配置

// 可配置的安全策略

const safetyConfig = {

pornThreshold: 0.5, // 色情内容阈值

hentaiThreshold: 0.65, // 动漫色情阈值

sexyThreshold: 0.7, // 性感内容阈值

neutralThreshold: 0.3 // 中性内容最低置信度

};

// 在检测逻辑中使用

const isImageSafe = (

pornScore < safetyConfig.pornThreshold &&

hentaiScore < safetyConfig.hentaiThreshold &&

(sexyScore < safetyConfig.sexyThreshold ||

neutralScore > safetyConfig.neutralThreshold)

);模型精度与局限性

我们使用的NSFWJS模型在测试集上的表现:

需要注意的局限性:

对艺术裸体可能误判(如经典油画)

对文字内容无效

卡通/动漫内容检测精度较低

极端暗光/模糊图片效果下降

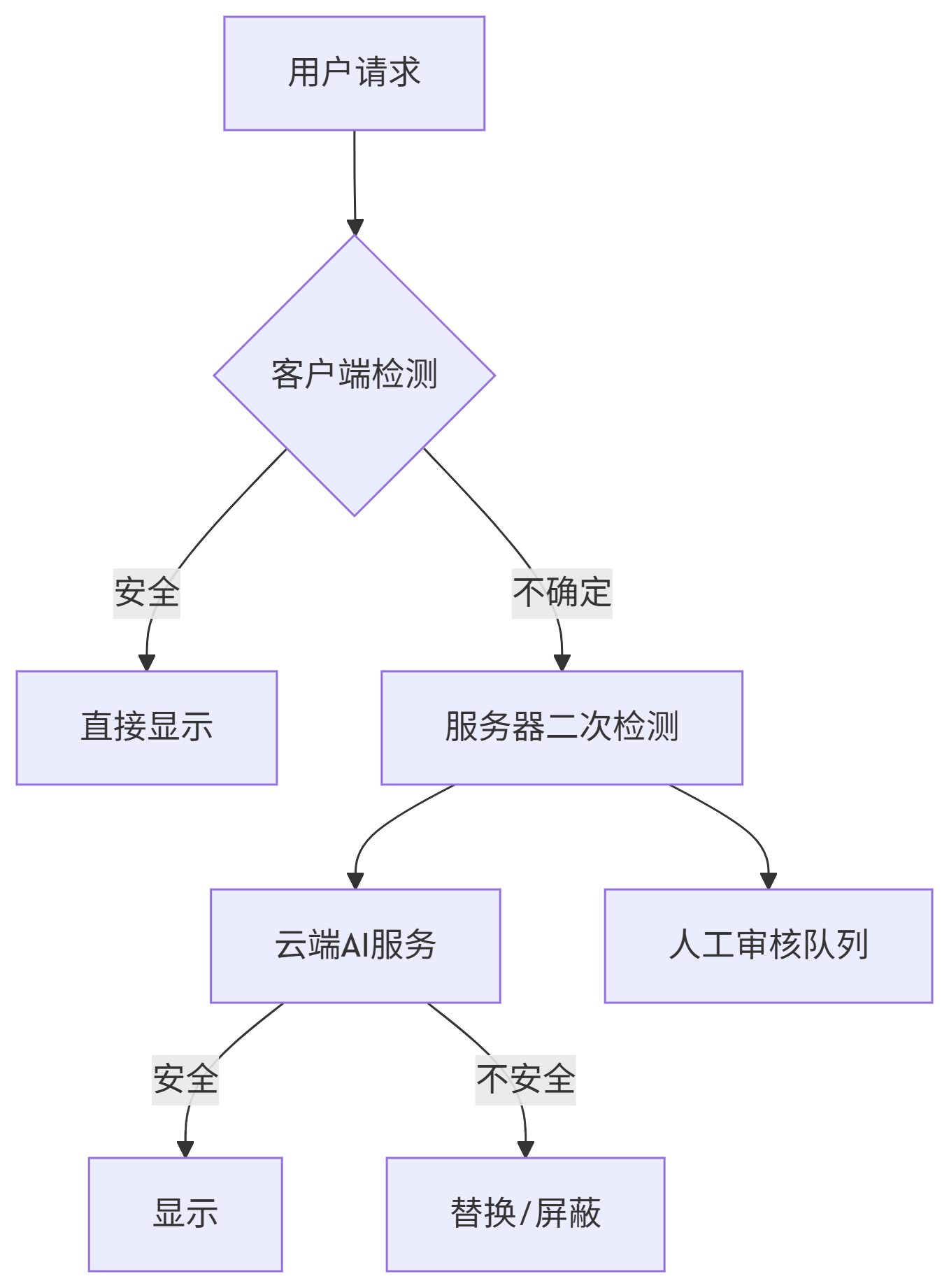

企业级解决方案建议

对于生产环境,建议采用分层过滤策略:

推荐组合方案:

前端初筛:TensorFlow.js(低成本)

服务端精筛:Google Cloud Vision API 或 AWS Rekognition

人工审核:对低置信度内容人工复核

下一步计划

我们的随机图片服务即将完成最后一块拼图:

部署到Serverless架构(下篇内容)

自动扩缩容

零服务器维护

按使用量付费

重要法律提示

即使使用AI过滤,仍需遵守当地法律法规

用户上传内容需保留审核记录

在隐私政策中说明内容检测机制

考虑提供"标记不当内容"功能

本文是原创文章,采用 CC BY-NC-ND 4.0 协议,完整转载请注明来自 Sakuraseven!

评论

匿名评论

隐私政策

你无需删除空行,直接评论以获取最佳展示效果